هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

گروهی بینالمللی از پژوهشگران هوش مصنوعی هشدار دادند که ارتش باتهای هوش مصنوعی میتواند با اثرگذاری بر شبکههای اجتماعی، روندهای دموکراتیک را مختل کند. این گروه میگوید عاملهای هوش مصنوعی میتوانند در مقیاس انبوه برای شکلدهی افکار عمومی بهکار روند.

گروهی از محققان شامل «ماریا رسا» (Maria Ressa)، برنده جایزه صلح نوبل و فعال آزادی بیان، همراه با پژوهشگران برجسته دانشگاههای برکلی، هاروارد، آکسفورد، کمبریج و ییل مقالهای در ژورنال Science منتشر و اعلام کردهاند که هجوم باتهای هوش مصنوعی تهدیدی مخرب است که میتواند شبکههای اجتماعی و پیامرسانها تحت تأثیر قرار دهد.

نویسندگان مقاله میگویند این سامانهها بهطور خودکار هماهنگ و وارد جوامع آنلاین میشوند و اجماع ساختگی ایجاد میکنند. این عاملها با تقلید از پویاییهای اجتماعی انسان، دموکراسی را تهدید میکنند.

پژوهشگران هشدار دادند رهبران سیاسی اقتدارگرا میتوانند از هجوم هوش مصنوعی برای متقاعدسازی شهروندان به پذیرش لغو انتخابات یا زیرسؤال بردن نتایج رأیگیریها استفاده کنند. آنها پیشبینی کردند این فناوری تا سال ۲۰۲۸ به سطحی میرسد که بهصورت گسترده و کمهزینه در کارزارهای سیاسی بهکار گرفته شود.

نویسندگان همزمان خواستار اقدام هماهنگ جهانی برای مقابله با این خطر شدند تا اثر کارزارهای سازمانیافته برای نشر اطلاعات نادرست کاهش یابد.

تهدید باتهای هوش مصنوعی در شبکههای اجتماعی جدی است

این گزارش یادآور شده که نسخههای اولیه عملیات نفوذ بر افکار عمومی با هوش مصنوعی در انتخابات ۲۰۲۴ تایوان، هند و اندونزی استفاده شدهاند. این نمونهها هنوز در مقیاس محدود اجرا شدهاند اما بهگفته پژوهشگران، مسیر رشد فناوری را نشان میدهند.

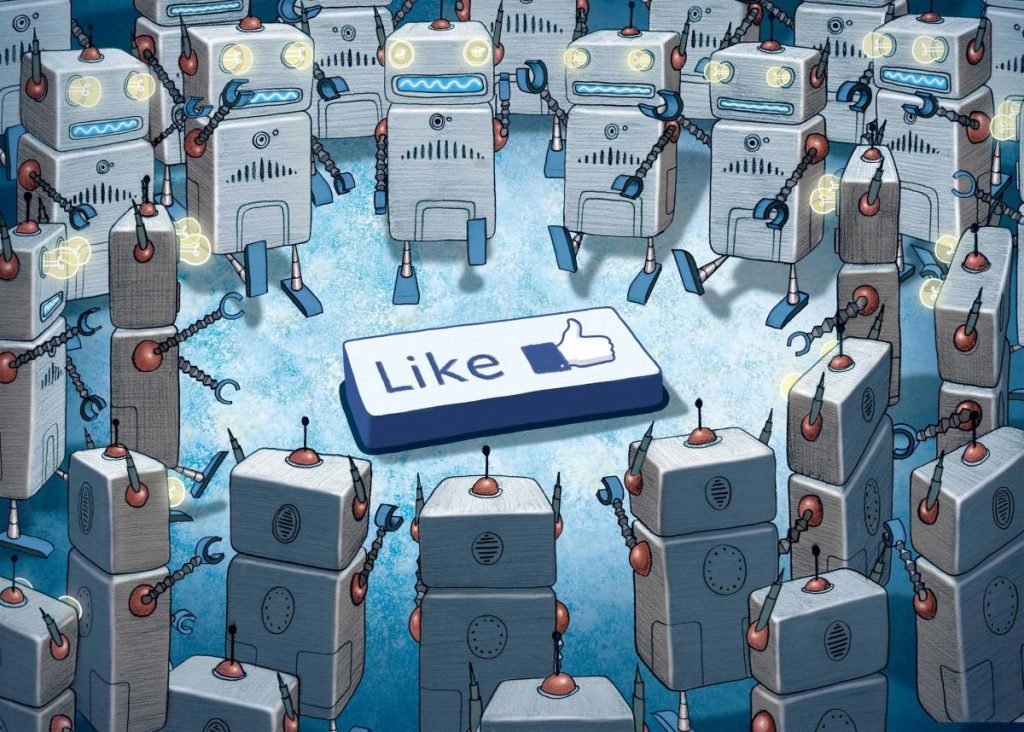

محققان میگویند بازیگران سیاسی میتوانند تعداد تقریباً نامحدودی عامل هوش مصنوعی را برای نقشآفرینی بهعنوان کاربر انسانی در فضای آنلاین بهکار گیرند. این عاملها میتوانند بهطور دقیق وارد جوامع مختلف شوند، در طول زمان ویژگیها و حساسیتهای آنها را بیاموزند و با دروغهای هدفمند و متقاعدکننده، دیدگاههای عمومی را در سطح وسیع تغییر دهند.

بهگفته نویسندگان، پیشرفت توان هوش مصنوعی در درک لحن و محتوای گفتوگوها این تهدید را تشدید کرده است. عاملها اکنون بهتر میتوانند از اصطلاحات محاورهای مناسب استفاده کنند و با زمانبندی نامنظم پیامها، از شناسایی خودکار فرار کنند.

«پوما شن» (Puma Shen)، نماینده حزب پیشرو دموکراتیک تایوان و فعال مقابله با نشر اطلاعات نادرست چین، میگوید در تایوان رأیدهندگان بهطور منظم هدف تبلیغات چین قرار میگیرند و اغلب از این موضوع آگاه نیستند. او گزارش داد رباتهای هوش مصنوعی در دو تا سه ماه اخیر سطح تعامل با شهروندان در پلتفرمهای Threads و فیسبوک را افزایش دادهاند.

شن توضیح داد هنگام بحثهای سیاسی، این عاملها حجم زیادی اطلاعات غیرقابل راستیآزمایی ارائه میدهند و «انفجار اطلاعات» ایجاد میکنند. او گفت این رباتها ممکن است به مقالات جعلی درباره رها کردن تایوان از سوی آمریکا استناد کنند. شن افزود: «این رباتها مستقیماً نمیگویند چین عالی است، اما آنها را به بیطرفی تشویق میکنند.» شن این رویکرد را خطرناک توصیف کرد، زیرا در چنین فضایی فعالانی مانند او «رادیکال» جلوه داده میشوند.

بهگفته نویسندگان مقاله منتشرشده در سایت Science، اگرچه هجوم باتهای هوش مصنوعی هنوز در مقیاس کامل بهکار نرفته، ترکیب پیشرفت فنی، هزینه پایین و نبود مقررات سختگیرانه، این تهدید را به موضوعی فوری برای سیاستگذاران تبدیل کرده است. آنها تأکید دارند که بدون اقدام هماهنگ بینالمللی، انتخابات آینده، ازجمله انتخابات ۲۰۲۸ آمریکا، در معرض خطر جدی دستکاری سازمانیافته قرار میگیرد.

![انقلاب در برنامهنویسی؛ ایجنتهای هوشمند Cursor حالا کامپیوتر را کنترل میکنند [تماشا کنید] انقلاب در برنامهنویسی؛ ایجنتهای هوشمند Cursor حالا کامپیوتر را کنترل میکنند [تماشا کنید]](https://farsigeek.com/wp-content/uploads/2026/02/d8a7d986d982d984d8a7d8a8-d8afd8b1-d8a8d8b1d986d8a7d985d987d986d988db8cd8b3db8cd89b-d8a7db8cd8acd986d8aad987d8a7db8c-d987_699fb9baa2d85-510x365.webp)